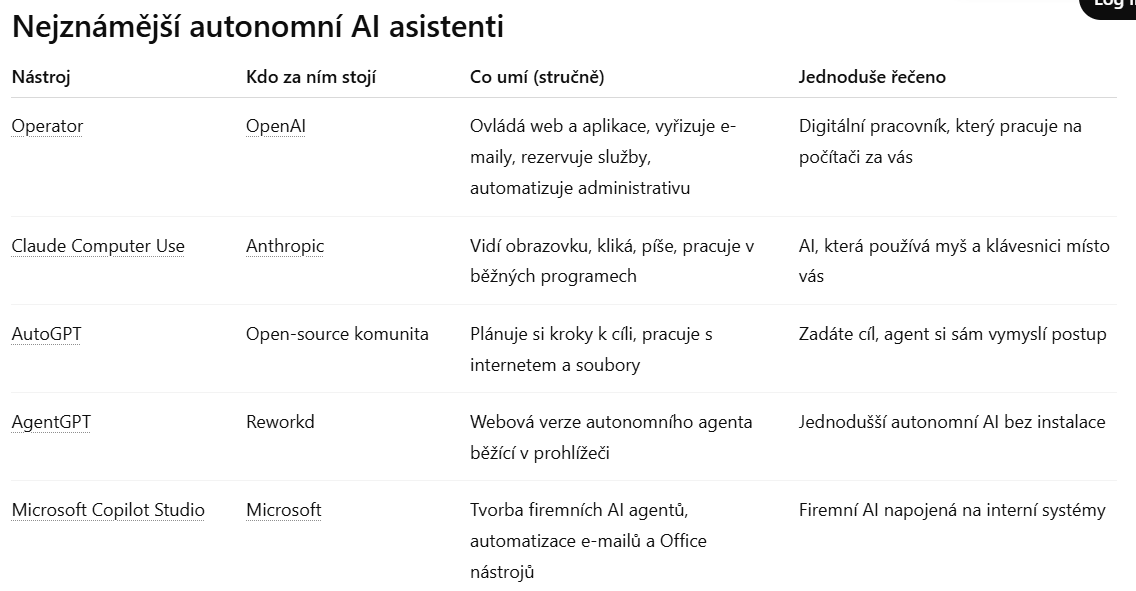

V posledních letech se umělá inteligence (AI) stala nedílnou součástí každodenního života. Jedním z nejvíce diskutovaných trendů jsou virtuální AI asistenti, kteří nejen odpovídají na otázky, ale přímo ovládají počítač a provádějí složité úkoly za uživatele. Tyto nástroje slibují revoluci v produktivitě – od vyřizování emailů přes objednávání letenek až po správu kalendářů. Nicméně odborníci varují před závažnými riziky, včetně krádeží dat a podvodů. V tomto článku si probereme, jak si lidé takové asistenty vytvářejí, představíme klíčové platformy a zdůrazníme potenciální nebezpečí.

Jak si lidé vytvářejí AI asistenty

Vytváření vlastních AI asistentů se stalo dostupné díky open-source projektům a pokročilým AI modelům, jako jsou ty od Anthropic (Claude) nebo OpenAI (ChatGPT). Lidé typicky začínají instalací softwaru, nebo virtuálního bota na svůj počítač, kde pak AI asistent běží neustále v pozadí. Tento asistent se pak propojuje s komunikačními aplikacemi, jako jsou WhatsApp, Telegram nebo Slack, přes které uživatel komunikuje třeba se svými fanoušky.

Například, pokud chcete, aby AI vyřídil emaily, nastavíte přístup k vašemu emailovému účtu (např. Gmail). Pro objednávání letenek se AI připojí k webovým službám jako Google Letenky, nebo k jiným rezervačním systémům.

Proces zapnutí AI asistenta na vašem počítači zahrnuje:

- Instalaci softwaru: Stačí spustit příkaz v terminálu, např. na Macu, Windows nebo Linuxu. Pro Molbot je to například příkaz „curl -fsSL https://molt.bot/install.sh | bash“

- Propojení s AI modelem: Použijete API klíče od poskytovatelů jako OpenAI nebo Anthropic, aby AI „myslel“ a rozhodoval.

- Integrace s nástroji: AI získá přístup k souborům v počítači, prohlížeči, emailům nebo kalendářům, což umožňuje autonomní akce, jako je odesílání emailů nebo rezervace letů.

- Personalizace: Uživatelé upravují „duši“ asistenta (soul.md soubor), kde definují chování, etické hranice a preference.

Tento přístup umožňuje, že AI nečeká na příkazy, ale proaktivně upozorňuje na důležité emaily nebo navrhuje letenky na základě volných termínů, nebo schzek ve vašem kalendáři.

Takže AI asistent vám například napíše: „vidím, že máš zítra schůzku v Berlíně → najdu ti levné letenky a pošlu ti návrh“.

Váš život se v podstatě „zploští“ do jedné konverzace, když napíšete AI asistentovi do chatu například: „potřebuju zarezervovat hotel v Egyptě, na 7 dní, do 10 000 Kč, na dovolenou v červenci“ → AI to vyřeší samo (prohledá, porovná, zaplatí, pošle vám potvrzení). AI asistenta si můžete nastavit i tak, že vám bude posílat jenom návrhy a zaplatí/objedná až po vašem potvrzení.

Díky tomu místo desítek samostatných aplikací (každá s vlastním loginem, UI atd.) máte jednu vrstvu nad vším – vašeho AI asistenta, který všechno orchestruje.

MCP (Model Context Protocol) – vytvořte si vlastního AI asistenta

Jste například firma, nebo zkušený programátor se specifickými požadavky na AI asistenty? Výše uvedená řešení pro vás nejsou dostatečná? Potom si můžete vytvořit od základu vlastního AI asistenta. Pro tento úkol je nejznámější platformou právě Model Context Protocol (MCP) od společnosti Anthropic.

MCP je otevřený standard, který umožňuje vývojářům napojit AI modely na vlastní nástroje, databáze, interní systémy nebo firemní API. Na rozdíl od hotových řešení dává plnou kontrolu nad tím, co asistent umí, k jakým datům má přístup a jaké akce může provádět.

Jednoduše řečeno: MCP je infrastruktura, díky které si firma nebo zkušený vývojář může postavit vlastního AI asistenta přesně na míru – místo aby používal univerzální hotový nástroj.

⚠️ Protože takové řešení pracuje s přístupovými údaji a citlivými daty, vyžaduje důsledné a bezpečné nastavení oprávnění.

Rizika a varování odborníků

Přestože AI asistenti slibují pohodlí, odborníci varují před závažnými riziky. To, co se tváří jako užitečný asistent, může být ve skutečnosti podvodník nebo zloděj se vzdáleným přístupem k vašemu počítači. Podle FBI hrozí krádeže dat, protože AI může být zneužito k velkým útokům na osobní informace. Experti z New York Department of Financial Services upozorňují na AI sociální inženýrství, kde podvodníci používají deepfakes k získání přístupu k účtům a krádežím. FBI píše: „Používání AI není zločin. Zločinci nebo jiní škodliví aktéři však mohou AI využívat k podpoře trestných, nebo nebezpečných činů“

Bezpečnostní firma Zenity prokázala, jak asistenti jako ChatGPT nebo Gemini mohou být zneužiti ke krádeži nebo manipulaci s daty přes speciálně navržené příkazy (prompt injection). V případě asistenta od OpenClaw byly odhaleny případy, kdy malware kradl konfigurační soubory včetně tokenů a emailů, čímž získal citlivá data. Před OpenClaw nejvíce varují odborníci.

Odborníci z Cisco varují, že takoví asistenti jsou „bezpečnostní noční můrou“, protože poskytují přístup k souborům a účtům, což umožňuje rychlé škálování útoků. Firma uvedla, že u AI asistentů neexistuje nic jako „dokonalé zabezpečení“.

Cisco na svém blogu píše: „Již dříve bylo hlášeno, že OpenClaw unikly klíče a přihlašovací údaje API v prostém textu, které mohou být ukradeny útočníky prostřednictvím prompt injection nebo nezabezpečených koncových bodů. Integrace OpenClaw s aplikacemi pro zasílání zpráv rozšiřuje oblast útoku na ty aplikace, kde mohou útočníci vytvářet škodlivé výzvy, které způsobují nežádoucí chování. Udělení neomezeného přístupu k vašim datům (i lokálně) agentovi AI je receptem na katastrofu, pokud dojde ke zneužití nebo ohrožení jakékoli konfigurace“

Noviny The Hacker News píšou: „Výzkumníci v oblasti kybernetické bezpečnosti odhalili případ infekce virem typu „stealer“, který úspěšně pronikl do konfiguračního prostředí OpenClaw (dříve Clawdbot a Moltbot ), jenž oběť používala.“

„Toto zjištění představuje významný milník v evoluci chování zlodějů informací: přechod od krádeže přihlašovacích údajů prohlížeče k získání „duše‘ a identit osobních agentů umělé inteligence,“ uvedl Hudson Rock .

To potvrzují i kybernetičtí odborníci z Experian, kteří říkají, že AI agenti způsobili masivní nárůst krádeží identit, protože vytvářejí syntetické profily nerozlišitelné od skutečných.

Další rizika zahrnují data leakage (únik dat), poisoning (otrava dat, kdy AI pak tyto data „sežere“ a dělá úkoly, které útočníci chtějí aby dělala) nebo model theft (krádež AI asistenta), kdy útočníci ukradnou nebo zmanipulují AI asistenta. Podle FTC jsou „služby technické podpory“ podobné – podvodníci nabízejí „opravy“ AI asistentů a následně získávají přístup k počítači pro krádeže. Anthropic přiznal, že jejich nástroje byly zneužity k velkým krádežím dat a vydírání.

Řešení: Oddělte citlivá data

Abychom minimalizovali rizika, odborníci doporučují používat dva počítače: jeden vyhrazený pouze pro AI asistenta, kde probíhají úkoly jako emaily nebo rezervace, a druhý pro citlivé informace – hesla, přístupy k bankovním účtům, finanční data nebo osobní dokumenty. Tímto způsobem, pokud dojde ke kompromitaci asistenta, zůstanou vaše klíčové data v bezpečí.

Používejte silné autentizace (dvoufaktorové), pravidelné aktualizace (AI asistentů) a monitorujte aktivity AI asistentů.

Důvěřujte pouze známým a ověřeným AI asistentům od renomovaných firem, jako jsou oficiální verze od OpenAI, Googlu, nebo Anthropic, i když ani zde nemáte 100% záruku bezpečnosti.

AI asistenty si nastavte tak, že nejdříve vám vždy musí poslat návrh a až po vašem schválení vykonají úkon.

Velkým obloukem se vyhněte neznámým „opravářům“ AI asistentů, nebo pochybným firmám s AI asistenty, kde ve skutečnosti se může jednat o poskytnutí vzdáleného přístupu k vašemu počítači s následnou krádeži dat, identity, nebo peněz z internetového bankovnictví.

AI asistenti přinášejí inovace a zefektivnění práce, ale jejich používání vyžaduje opatrnost. S růstem technologií roste i bezpečnostní odpovědnost uživatelů.

Nezávislost naší redakce můžete podpořit finančním darem v jakékoliv výši bankovním převodem na účet:

2400157743/2010

QR kód obsahuje údaje k platbě. Výši částky si určíte sami.

Staňte se naším redaktorem.

Facebook komentáře